AI对AI大肆入侵!Open WebUI遭全球1.7万次攻击,Linux和Win用户岌岌可危

随着科技的飞速发展,人工智能(AI)的应用已经渗透到我们生活的方方面面。然而,近日网络安全公司Sysdig的警告引发了我们对AI攻击的新一轮关注。Sysdig的研究团队发现,攻击者正利用配置不当的Open WebUI实例,通过AI生成的恶意软件入侵系统,威胁Linux和Windows用户。

Open WebUI 是一个可扩展、功能丰富且用户友好的自托管AI平台,完全支持离线运行。它支持多种大型语言模型运行器,兼容Ollama和OpenAI等API,并内置了用于RAG的推理引擎,使其成为一个强大的AI部署解决方案。然而,这也为攻击者提供了新的攻击面。

Sysdig的研究团队发现,攻击者通过在线暴露且无身份验证的系统获取管理员权限,上传高度混淆的Python脚本“pyklump”。这个脚本被ChatGPT代码检测器分析为“极有可能由AI生成或高度依赖AI辅助”,这揭示了AI工具在恶意软件开发中的新角色。

攻击并非一次性完成,而是通过多阶段方式展开。首先,执行脚本利用Discord webhook进行指挥与控制(C2)通信,伪装成合法网络流量以规避检测。这一步的巧妙之处在于,攻击者巧妙地利用了我们的信任系统,将恶意行为伪装成合法行为,增加了防御的难度。

在攻击进行的同时,攻击者还使用“processhider”工具隐藏加密矿工等恶意进程,并通过“argvhider”掩盖挖矿池URL和钱包地址等关键命令行参数。这种狡猾的手法使得恶意行为难以被发现,增加了受害者被攻击的时间和难度。

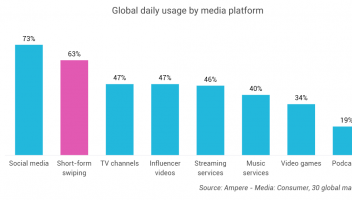

在线暴露的Open WebUI实例数量惊人,据微软2024年《数字防御报告》显示,AI驱动的网络攻击每日超过6亿次。这表明,随着AI技术的普及,攻击者利用生成式AI自动化攻击方法的趋势愈发明显。

更令人担忧的是,这种攻击不仅限于在线环境。在Windows系统中,攻击者安装Java Development Kit(JDK),运行从C2服务器下载的恶意JAR文件“application-ref.jar”,加载包含XOR加密和沙箱规避的DLL组件,目标包括Chrome扩展和Discord凭据。这表明,攻击者已经开始针对本地系统进行攻击,利用系统的漏洞和弱点进行更深层次的入侵。

面对这样的威胁,我们需要采取有效的防御措施。首先,我们需要加强对AI系统的安全防护,包括对输入的数据进行严格的审查,对输出进行实时监测和预警等。其次,我们需要提高系统的安全性,包括加强身份验证,防止未经授权的访问,以及及时更新系统和软件以修复漏洞等。最后,我们需要提高公众的安全意识,教育人们如何识别和应对AI攻击,以及在受到攻击时如何采取适当的措施。

总的来说,AI对AI的入侵正在成为新的攻击趋势。Open WebUI的出现为攻击者提供了新的攻击面,而生成式AI自动化攻击方法的普及则加剧了这一威胁。我们需要高度重视这个问题,采取有效的措施来应对。只有这样,我们才能保护我们的系统和数据安全,维护我们的数字世界。

(免责声明:本网站内容主要来自原创、合作伙伴供稿和第三方自媒体作者投稿,凡在本网站出现的信息,均仅供参考。本网站将尽力确保所提供信息的准确性及可靠性,但不保证有关资料的准确性及可靠性,读者在使用前请进一步核实,并对任何自主决定的行为负责。本网站对有关资料所引致的错误、不确或遗漏,概不负任何法律责任。

任何单位或个人认为本网站中的网页或链接内容可能涉嫌侵犯其知识产权或存在不实内容时,应及时向本网站提出书面权利通知或不实情况说明,并提供身份证明、权属证明及详细侵权或不实情况证明。本网站在收到上述法律文件后,将会依法尽快联系相关文章源头核实,沟通删除相关内容或断开相关链接。 )